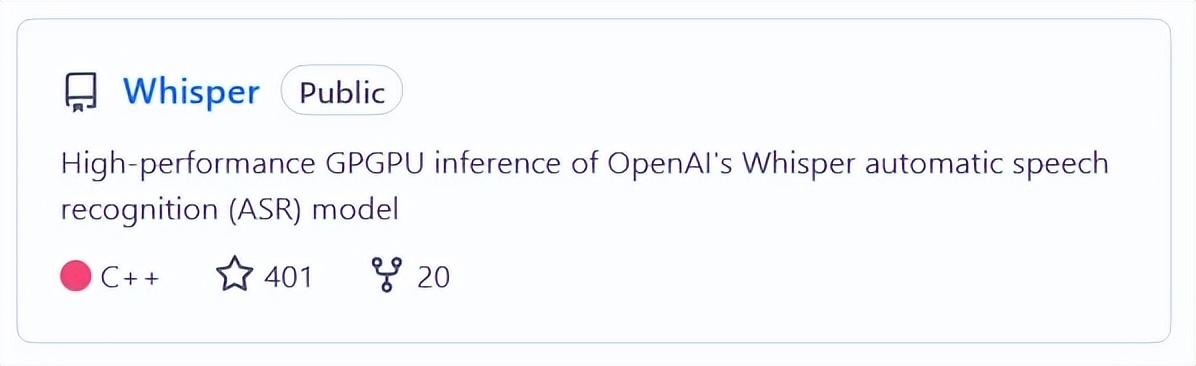

在隔壁小众软件看到了一款有意思的工具-“Const-me/Whisper”。

原版Whisper是OpenAI做的一个神经网络模型,它可以在本地实时语音转文字,用来翻译和做字幕等等,而Const-me的版本将Whisper做成了Windows的版本,还添加了GPU加速。

在官方的GitHub页面上,可以看到这个工具还有不少特点,比如说项目采用纯C++实现,除了系统基本组件没有运行依赖、内存占用低、支持大多数音频和视频格式、支持大多数音频捕获设备、比OpenAI的实现还快。

主要的使用限制是系统版本,Windows 8.1以下和32位的系统是用不了的。

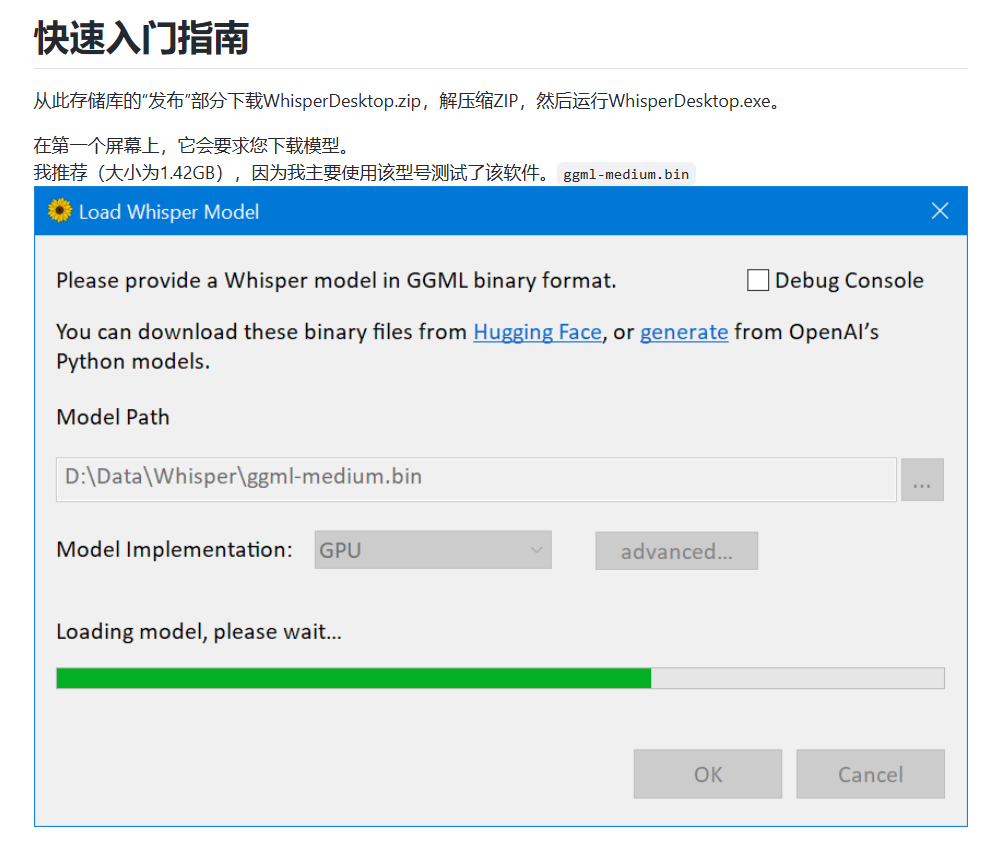

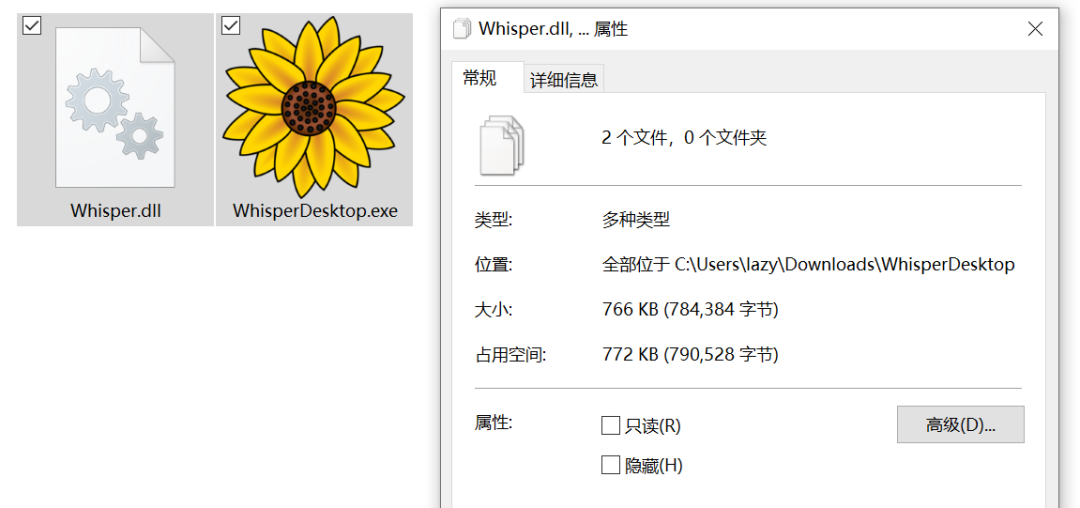

软件的使用很简单,一个用于启动的界面环境,解压出来1MB不到,一个用于识别的语言模型,模型有多个版本,想要正常使用得用1G以上的模型,下载文件之后,直接运行启动器即可。

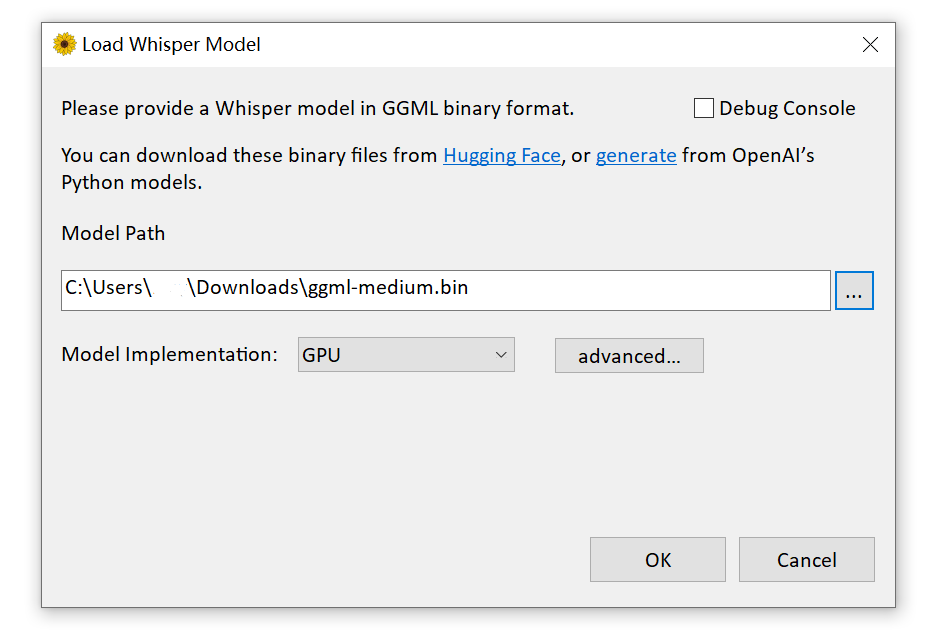

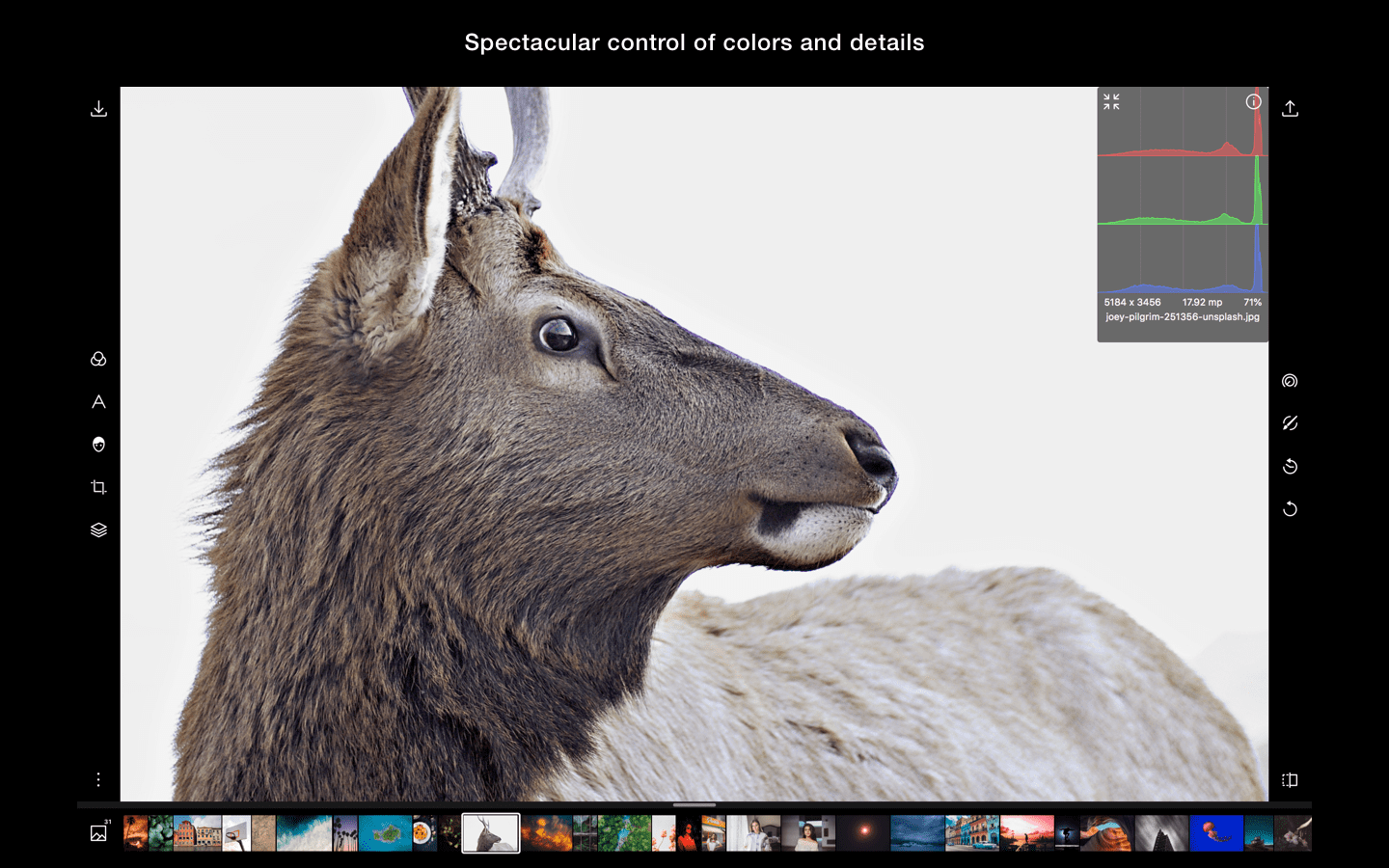

打开之后就能看见这朴实无华的界面,软件没有几个按钮,虽然是英文的,但是模型路径和高级设置一看就明白。

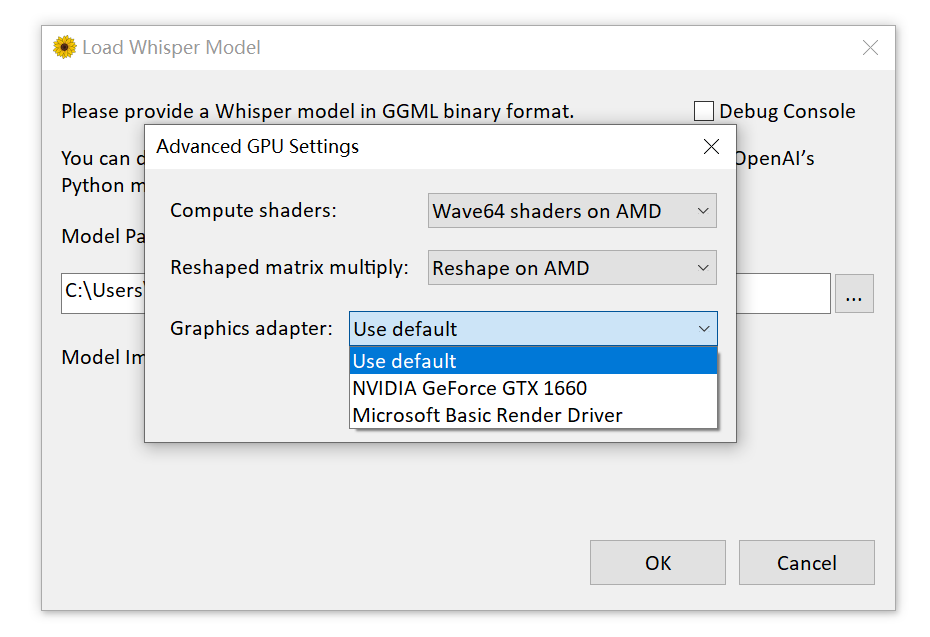

在高级设置里面可以设置要调用的GPU,这个保持默认就行。

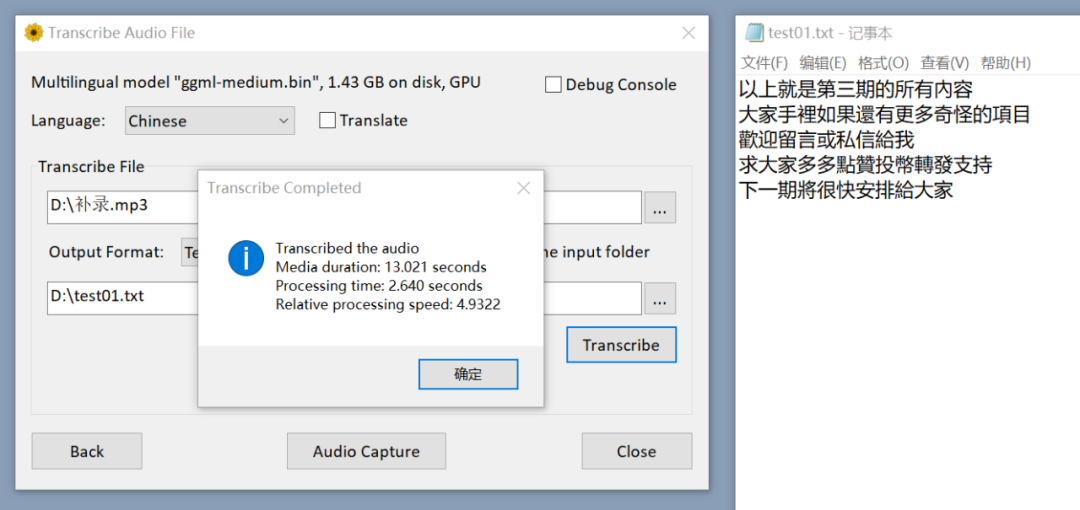

之后就能看到软件的主界面了,点开选择语言,可以看到支持的语言还是挺多的,这里就先来试试中文。

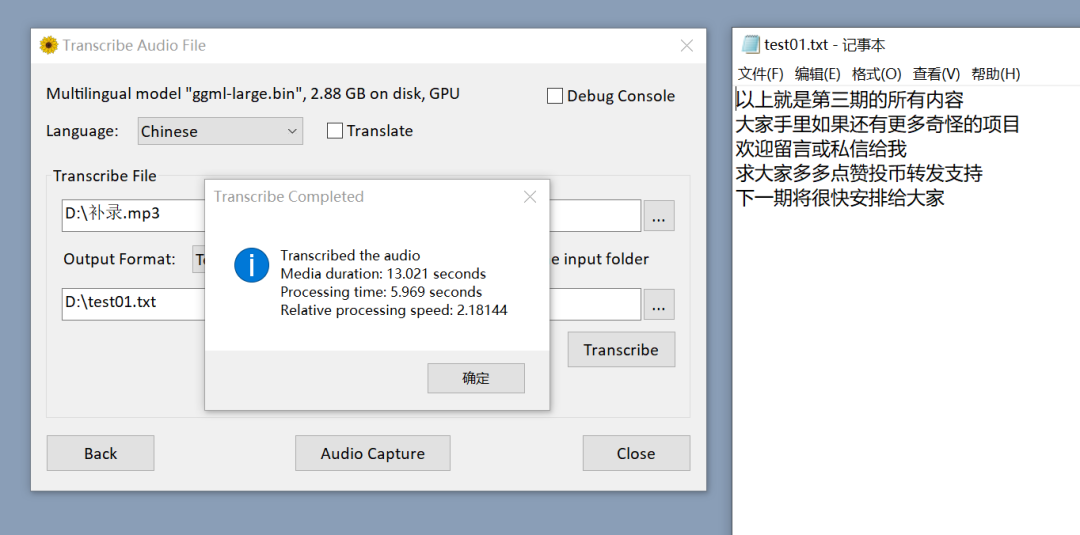

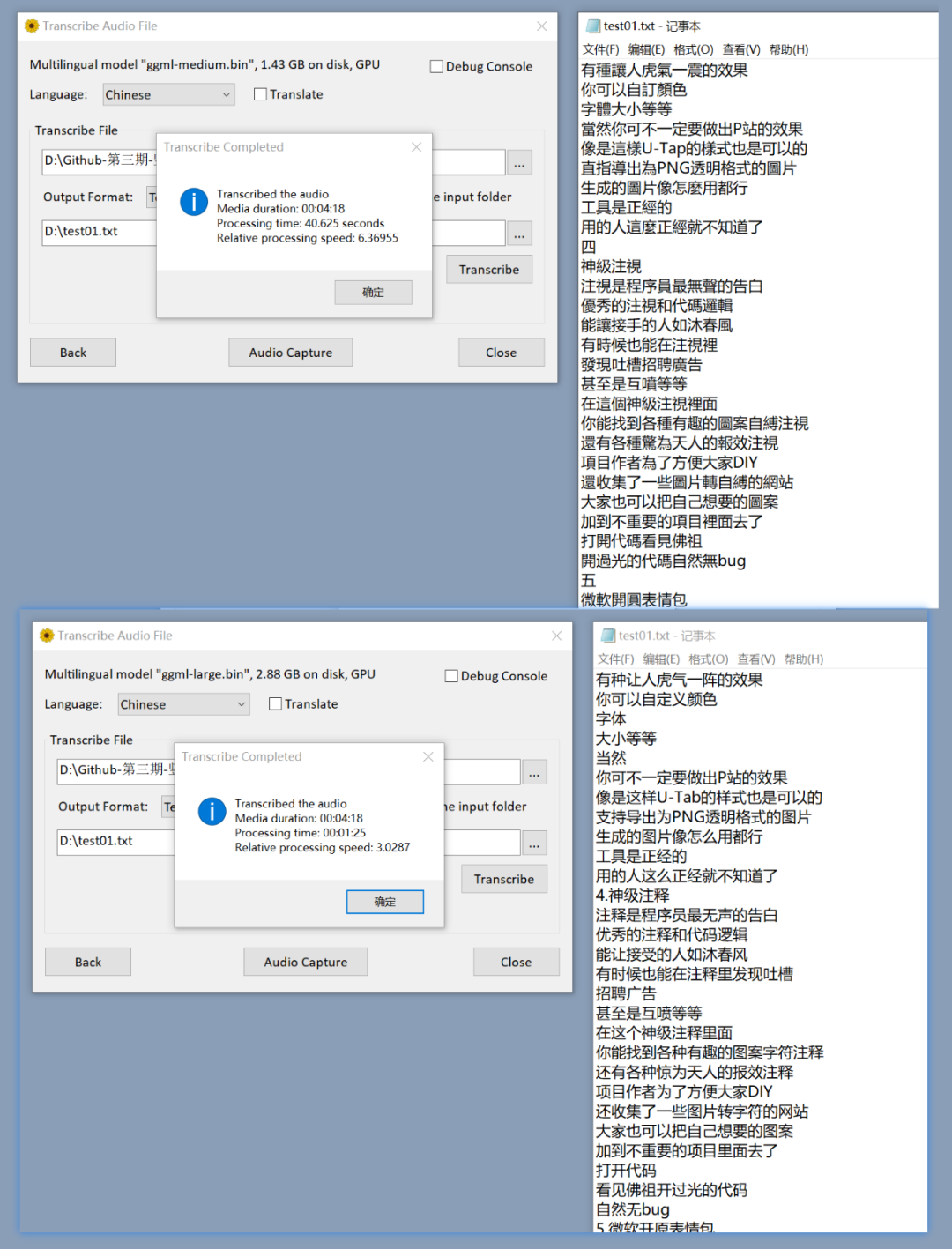

在测试的时候发现用1.42GB的模型,默认出来的是繁体,用2.88GB模型出来的是简体,这个也可能是系统环境的原因,大家可以自己测试一下。

测试用的显卡是GTX1660,转换速度在可接受范围之内,上面这种简短的句子,用大的识别模型,在某些简单的语境条件下,以及加上最重要的因素——运气好的话,竟然有100%的准确度。

暂停一下

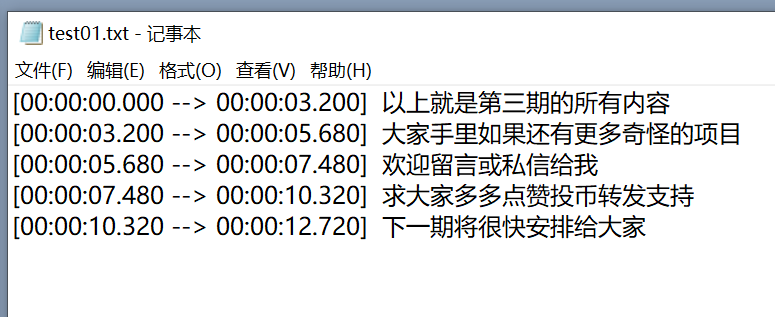

除了音频文件,直接放视频也是可以的,但是只要涉及的内容一广,这个在本地运行的缺点就暴露出来了,生成的文本一言难尽,在有数字的时候会自己转换成阿拉伯数字,有英文混杂的时候也会自己尝试首字母大写,但是在转换效果上,一眼望过去有不少同音字错误,对于中文的前后文联想能力比较差。

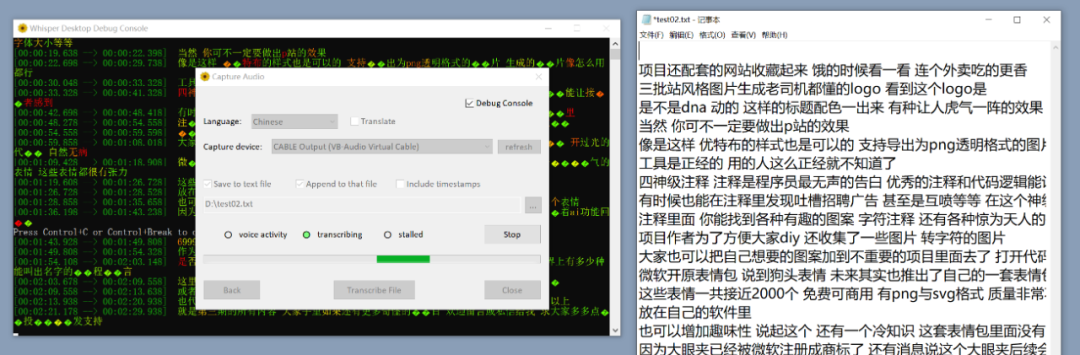

支持实时录制音频。

这个比Windows自带的语言输入效果要好一点,同样的音频速度,这个工具不会出现丢字的情况。

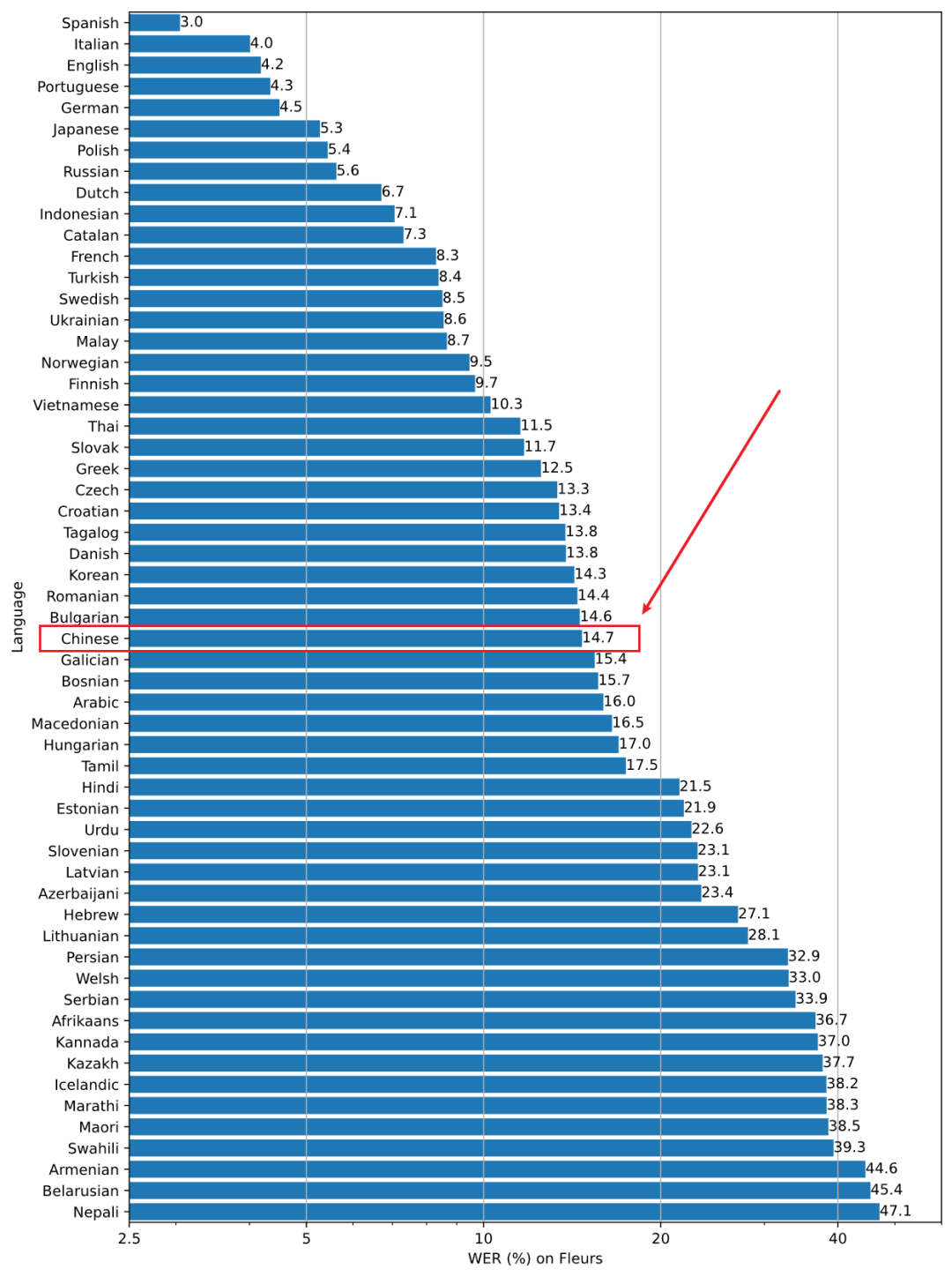

官方给出的Whisper识别能力图如下,主要还是用来识别英文。

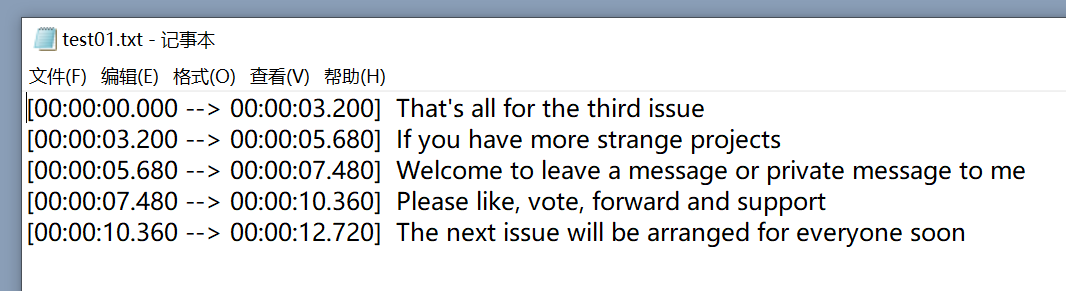

其他功能上,可以添加时间标记和直接翻译成英文。

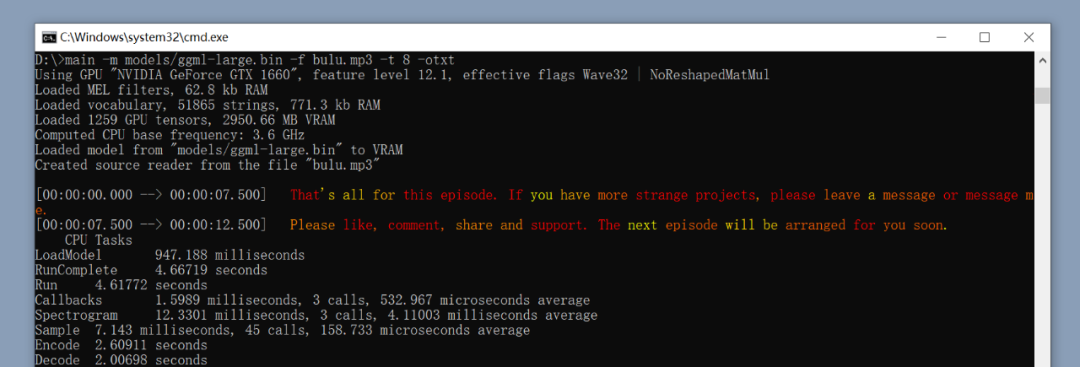

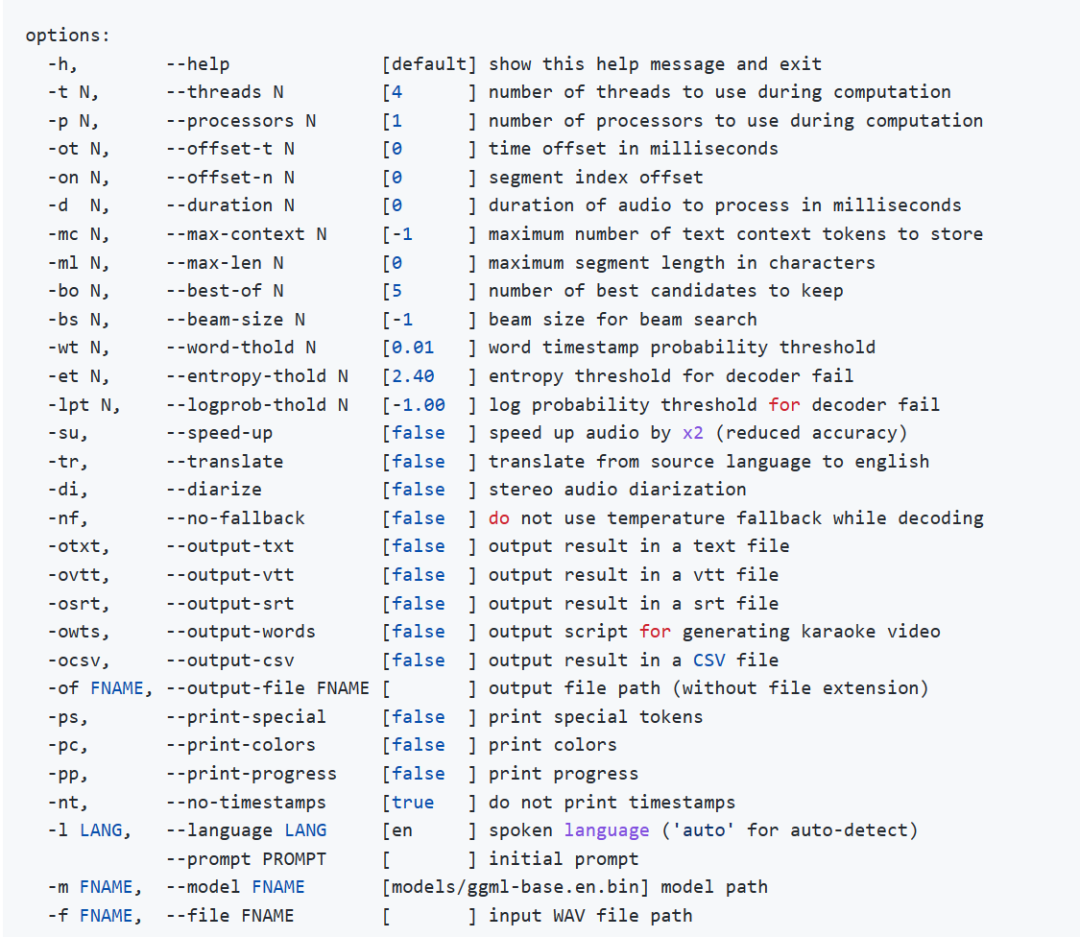

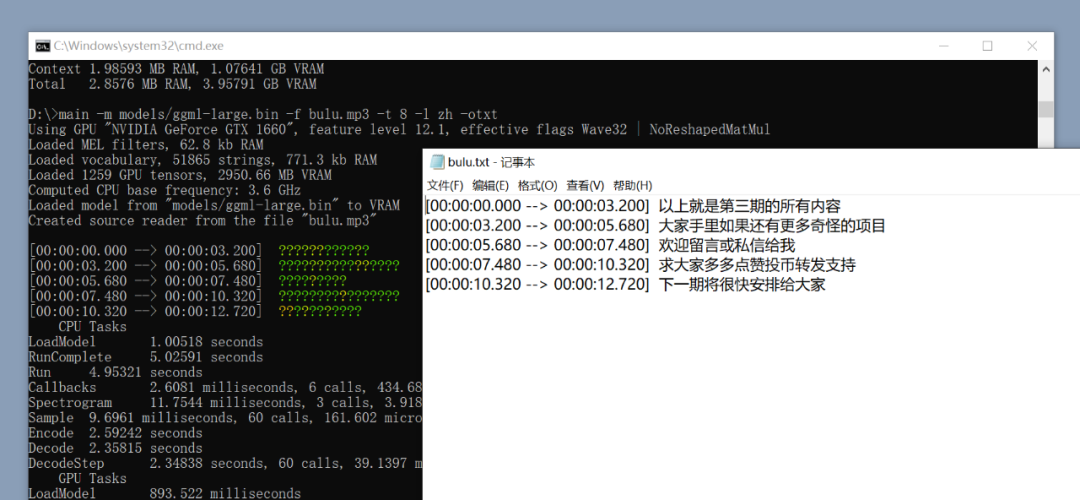

想要控制具体的参数,也可以使用控制台的版本,还会展示对应数值的置信度。

输出中文的话会出现一堆问号,这个不是控制台的编码显示问题,但是在输入转换指令后,在对应路径下面的文本生成是没有问题的。

有了这个,就可以配合像是Quicker一类的快捷工具,做到本地一键转换成文本了。

比较遗憾的是,这个小工具目前只支持将转换的音频转换为英文,要是未来可以转换成任意语言的话,那可玩性就很高了。

423下载站

423下载站

评论前必须登录!

立即登录 注册